实例介绍

【实例简介】

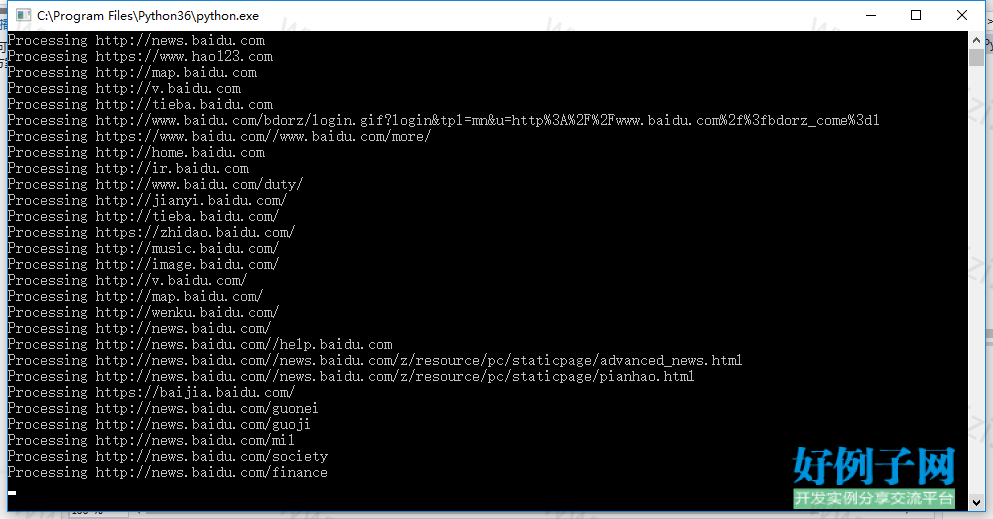

【实例截图】

【核心代码】

#!/usr/bin/python # -*- coding: UTF-8 -*- from bs4 import BeautifulSoup import requests.exceptions from urllib.parse import urlsplit from collections import deque import re # 一个需要爬行的url队列 new_urls = deque(['https://www.baidu.com/']) # 一组我们已经爬过的url processed_urls = set() emails = set() # 一个一个地处理url,直到我们耗尽队列 while len(new_urls): # 将下一个url从队列移动到处理的url集合 url = new_urls.popleft() processed_urls.add(url) # 提取基本url以解析相对链接 parts = urlsplit(url) base_url = "{0.scheme}://{0.netloc}".format(parts) path = url[:url.rfind('/') 1] if '/' in parts.path else url # 获取url的内容 print("Processing %s" % url) try: response = requests.get(url) except (requests.exceptions.MissingSchema, requests.exceptions.ConnectionError): # 忽略页面错误 continue # 提取所有电子邮件地址并将它们添加到结果集 new_emails = set(re.findall(r"[a-z0-9\.\- _] @[a-z0-9\.\- _] \.[a-z] ", response.text, re.I)) emails.update(new_emails) # 为html文档创建一个beutiful汤 soup = BeautifulSoup(response.text) #查找并处理文档中的所有锚 for anchor in soup.find_all("a"): # 从锚中提取链接url link = anchor.attrs["href"] if "href" in anchor.attrs else '' # 解决相对链接 if link.startswith('/'): link = base_url link elif not link.startswith('http'): link = path link # 如果没有队列或处理,将新url添加到队列中 if not link in new_urls and not link in processed_urls: new_urls.append(link)

标签: 数据

相关软件

小贴士

感谢您为本站写下的评论,您的评论对其它用户来说具有重要的参考价值,所以请认真填写。

- 类似“顶”、“沙发”之类没有营养的文字,对勤劳贡献的楼主来说是令人沮丧的反馈信息。

- 相信您也不想看到一排文字/表情墙,所以请不要反馈意义不大的重复字符,也请尽量不要纯表情的回复。

- 提问之前请再仔细看一遍楼主的说明,或许是您遗漏了。

- 请勿到处挖坑绊人、招贴广告。既占空间让人厌烦,又没人会搭理,于人于己都无利。

关于好例子网

本站旨在为广大IT学习爱好者提供一个非营利性互相学习交流分享平台。本站所有资源都可以被免费获取学习研究。本站资源来自网友分享,对搜索内容的合法性不具有预见性、识别性、控制性,仅供学习研究,请务必在下载后24小时内给予删除,不得用于其他任何用途,否则后果自负。基于互联网的特殊性,平台无法对用户传输的作品、信息、内容的权属或合法性、安全性、合规性、真实性、科学性、完整权、有效性等进行实质审查;无论平台是否已进行审查,用户均应自行承担因其传输的作品、信息、内容而可能或已经产生的侵权或权属纠纷等法律责任。本站所有资源不代表本站的观点或立场,基于网友分享,根据中国法律《信息网络传播权保护条例》第二十二与二十三条之规定,若资源存在侵权或相关问题请联系本站客服人员,点此联系我们。关于更多版权及免责申明参见 版权及免责申明

网友评论

我要评论