实例介绍

【实例简介】 自己动手写神经网络_源代码

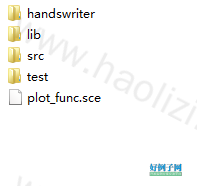

【实例截图】

【核心代码】

package geym.nn.mlperceptron;

import java.util.Arrays;

import java.util.Random;

import org.neuroph.core.NeuralNetwork;

import org.neuroph.core.data.DataSet;

import org.neuroph.core.data.DataSetRow;

import org.neuroph.core.events.LearningEvent;

import org.neuroph.core.events.LearningEventListener;

import org.neuroph.core.learning.LearningRule;

import org.neuroph.nnet.learning.BackPropagation;

import org.neuroph.nnet.learning.MomentumBackpropagation;

import org.neuroph.util.TransferFunctionType;

public class MomentumParityCheck implements LearningEventListener{

public static void main(String[] args) {

new MomentumParityCheck().run();

}

public static double[] int2double(int i){

double[] re=new double[32];

for(int j=0;j<32;j ){

re[j]=(double)((i>>j)&1);

}

return re;

}

public static String networkOutputDisplay(double[] networkOutput){

if(((int)networkOutput[3])==1)return "正偶数";

if(((int)networkOutput[2])==1)return "负偶数";

if(((int)networkOutput[1])==1)return "正奇数";

if(((int)networkOutput[0])==1)return "负奇数";

return "未知";

}

public static String correctClassify(int i){

if(i>0 && i%2==0){

return "正偶数";

}else if(i<0 && i%2==0){

return "负偶数";

}else if(i>0 && i%2!=0){

return "正奇数";

}else if(i<0 && i%2!=0){

return "负奇数";

}

return "0";

}

/**

* 0001 正偶数

* 0010 负偶数

* 0100 正奇数

* 1000 负奇数

* @param i

* @return

*/

public static double[] int2prop(int i){

double[] pe={0d,0d,0d,1d};

double[] ne={0d,0d,1d,0d};

double[] po={0d,1d,0d,0d};

double[] no={1d,0d,0d,0d};

if(i>0 && i%2==0){

return pe;

}else if(i<0 && i%2==0){

return ne;

}else if(i>0 && i%2!=0){

return po;

}else if(i<0 && i%2!=0){

return no;

}

return pe;

}

public void run() {

DataSet trainingSet = new DataSet(32, 4);

for(int i=0;i<2000;i ){

int in=new Random().nextInt();

trainingSet.addRow(new DataSetRow(int2double(in), int2prop(in)));

}

// 创建神经网络 32个输入 10个神经元隐层 4个

MlPerceptron myMlPerceptron = new MlPerceptronBinOutput(TransferFunctionType.SIGMOID, 32, 10, 4);

myMlPerceptron.setLearningRule(new MomentumBackpropagation());

LearningRule learningRule = myMlPerceptron.getLearningRule();

learningRule.addListener(this);

// learn the training set

System.out.println("Training neural network...");

myMlPerceptron.learn(trainingSet);

// test perceptron

System.out.println("Testing trained neural network");

testNeuralNetwork(myMlPerceptron);

}

public static void testNeuralNetwork(NeuralNetwork neuralNet) {

int badcount=0;

int COUNT=50000;

for(int i=0;i<COUNT;i ){

int in=new Random().nextInt();

double[] inputnumber=int2double(in);

neuralNet.setInput(inputnumber);

neuralNet.calculate();

double[] networkOutput = neuralNet.getOutput();

System.out.print("Input: " in);

String networkOutputDisplay=networkOutputDisplay(networkOutput);

System.out.println(" Output: " Arrays.toString( networkOutput) networkOutputDisplay );

String cc=correctClassify(in);

if(!cc.equals(networkOutputDisplay)){

badcount ;

System.out.print("判别错误:" in);

System.out.print(" correctClassify=" cc);

System.out.println(" networkOutputDisplay=" networkOutputDisplay);

}

}

System.out.println("正确率:" (COUNT-badcount*1.0)/COUNT*100.0 "%");

}

@Override

public void handleLearningEvent(LearningEvent event) {

BackPropagation bp = (BackPropagation)event.getSource();

System.out.println(bp.getCurrentIteration() ". iteration : " bp.getTotalNetworkError());

}

}

好例子网口号:伸出你的我的手 — 分享!

小贴士

感谢您为本站写下的评论,您的评论对其它用户来说具有重要的参考价值,所以请认真填写。

- 类似“顶”、“沙发”之类没有营养的文字,对勤劳贡献的楼主来说是令人沮丧的反馈信息。

- 相信您也不想看到一排文字/表情墙,所以请不要反馈意义不大的重复字符,也请尽量不要纯表情的回复。

- 提问之前请再仔细看一遍楼主的说明,或许是您遗漏了。

- 请勿到处挖坑绊人、招贴广告。既占空间让人厌烦,又没人会搭理,于人于己都无利。

关于好例子网

本站旨在为广大IT学习爱好者提供一个非营利性互相学习交流分享平台。本站所有资源都可以被免费获取学习研究。本站资源来自网友分享,对搜索内容的合法性不具有预见性、识别性、控制性,仅供学习研究,请务必在下载后24小时内给予删除,不得用于其他任何用途,否则后果自负。基于互联网的特殊性,平台无法对用户传输的作品、信息、内容的权属或合法性、安全性、合规性、真实性、科学性、完整权、有效性等进行实质审查;无论平台是否已进行审查,用户均应自行承担因其传输的作品、信息、内容而可能或已经产生的侵权或权属纠纷等法律责任。本站所有资源不代表本站的观点或立场,基于网友分享,根据中国法律《信息网络传播权保护条例》第二十二与二十三条之规定,若资源存在侵权或相关问题请联系本站客服人员,点此联系我们。关于更多版权及免责申明参见 版权及免责申明

网友评论

我要评论